Source : The Intercept, Sam Biddle, 13-04-2018

Depuis que le scandale Cambridge Analytica a éclaté en mars, Facebook a essayé de prendre une position morale sur votre vie privée, se démarquant des pratiques sans scrupules de la société de conseil politique britannique. « La protection des données personnelles est au cœur de tout ce que nous faisons », a écrit Paul Grewal, l’avocat général adjoint de Facebook, quelques semaines avant que Mark Zuckerberg, fondateur et PDG, se rende au Capitole pour donner des assurances similaires, en disant aux législateurs : « A tous les niveaux, nous avons la responsabilité, non seulement de développer des outils, mais aussi de veiller à ce que ces outils soient utilisés à bon escient ». Mais, en réalité, un document confidentiel de Facebook examiné par le journal The Intercept, montre que les deux compagnies sont beaucoup plus semblables que ce que le réseau social voudrait vous faire croire.

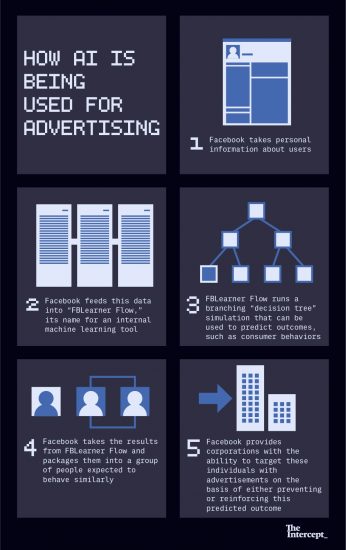

Ce document récent, qualifié de « confidentiel », expose les grandes lignes d’un nouveau service de publicité qui élargit la façon dont le réseau social vend aux entreprises l’accès à ses utilisateurs et à leur vie : Au lieu de simplement offrir aux annonceurs la possibilité de cibler les gens en fonction de la démographie et des préférences des consommateurs, Facebook offre plutôt la possibilité de les cibler en fonction de leur comportement à venir, de ce qu’ils achèteront et de ce qu’ils penseront. Ces capacités sont le fruit d’un système de prédiction basé sur l’intelligence artificielle, dévoilé pour la première fois par Facebook en 2016 et surnommé « FBLearner Flow ».

Une page du document fait état de la capacité de Facebook à « prédire les comportements futurs », permettant aux entreprises de cibler les gens sur la base de décisions qu’ils n’ont même pas encore prises. Potentiellement, cela pourrait donner à des tiers l’occasion de modifier la trajectoire prévue d’un consommateur. Ici, Facebook explique comment il peut passer au peigne fin toute sa base d’utilisateurs, riche de plus de 2 milliards d’individus, pour en extraire des millions de personnes « à risque », qui pourraient quitter une marque au profit d’un concurrent. Ces personnes pourraient alors être ciblées par des messages publicitaires agressifs qui pourraient anticiper et faire changer complètement leur décision – ce que Facebook appelle « une efficacité marketing renforcée ». Ce n’est pas Facebook qui vous montre des publicités Chevrolet parce que vous avez consulté le site Ford toute la semaine – un truc vieux comme le monde dans la sphère du marketing en ligne – mais plutôt Facebook qui utilise les faits de votre vie pour prédire que, dans un futur proche, vous allez en avoir marre de votre voiture. Facebook appelle ce service « Prédiction de fidélité ».

Facebook explique qu’il peut passer au peigne fin ses 2 milliards d’utilisateurs pour en qualifier des millions de « à risque », susceptibles de passer à une marque concurrente.

Dans l’esprit, la publicité de Facebook par l’intelligence artificielle est proche du profilage « psychographique » controversé des électeurs par Cambridge Analytica, qui utilise les données démographiques banales des consommateurs (ce qui vous intéresse, où vous vivez) pour prédire l’action politique. Mais contrairement à Cambridge Analytica et à ses pairs, qui doivent se contenter des données qu’ils peuvent extraire des interfaces publiques de Facebook, Facebook est assis sur le filon principal, avec un accès sans entrave aux bases de données colossales sur le comportement et les préférences. Un rapport ProPublica de 2016 a trouvé quelques 29 000 critères caractérisant chacun des utilisateurs de Facebook.

Zuckerberg a œuvré à démarquer son entreprise de Cambridge Analytica, dont les actions pour le compte de Donald Trump ont été alimentées par les données de Facebook, disant aux journalistes, lors d’une récente conférence téléphonique, que le réseau social est un gardien attentif de l’information :

La vaste majorité des données que Facebook connaît de vous, c’est parce que vous avez choisi de les partager. D’accord ? Vous n’êtes pas pistés. Il y a d’autres compagnies de l’Internet, des courtiers en données ou des gens qui pourraient essayer de pister pour vendre des données, mais nous n’achetons pas ni ne vendons… Pour une raison que j’ignore, nous n’avons pas réussi à éradiquer cette idée très répandue , depuis des années, que nous voulions vendre des données aux annonceurs. Ce n’est pas le cas. Ce n’est pas une chose que nous faisons. En fait, cela va à l’encontre de nos propres intérêts. Même si nous voulions le faire, cela n’aurait pas de sens.

Le document de Facebook fait un geste similaire en faveur de la protection des utilisateurs, soulignant que toutes les données sont « agrégées et rendues anonymes [pour protéger] la vie privée des utilisateurs », ce qui signifie que Facebook loue l’accès à ses données plutôt que de les vendre. Mais cette ligne de défense se contente de jouer sur les mots : Peu importe qui exploite les données brutes de Facebook, le résultat final, que la compagnie s’empresse de monétiser, est une connaissance publicitaire qui touche à votre intimité – désormais emballée et enrichie par le projet d’apprentissage automatique de la compagnie. Et bien que Zuckerberg et compagnie disent techniquement l’exacte vérité en avançant que Facebook ne vend pas vos données, ce qu’ils vendent vraiment est beaucoup plus précieux, le genre de connaissances du 21e siècle qui ne sont accessibles que pour une entreprise aux ressources à peu près illimitées. La réalité est que Zuckerberg a beaucoup plus en commun avec des compagnies comme Equifax et Experian que toute autre entreprise axée sur le consommateur. Facebook est essentiellement un grossiste en données, point final.

Le document ne détaille pas lesquelles des informations des profils utilisateurs de Facebook sont utilisées pour alimenter le système de prédiction, mais il mentionne la géolocalisation, les informations sur les équipements, les détails du réseau Wi-Fi, l’utilisation de vidéos, les affinités et les détails des amitiés, y compris comment un utilisateur est comparable à ses amis. Toutes ces données peuvent ensuite alimenter FBLearner Flow, qui s’en servira essentiellement modéliser une facette de la vie d’un utilisateur, dont les résultats seront vendus à une entreprise cliente. L’entreprise décrit cette pratique comme étant « l’expertise de Facebook en matière d’apprentissage automatique » utilisée pour les « défis fondamentaux de l’entreprise ».

Les experts consultés par The Intercept avancent que les systèmes décrits dans le document soulèvent divers problèmes éthiques, y compris la façon dont la technologie pourrait être utilisée pour manipuler les utilisateurs, influencer les élections ou renforcer le pouvoir des entreprises. Facebook a l’obligation morale de révéler comment il utilise l’intelligence artificielle pour monétiser vos données, a déclaré Tim Hwang, directeur de la Harvard-MIT Ethics and Governance of AI Initiative [Initiative Harvard – MIT sur l’éthique et la gouvernance en matière d’intelligence artificielle], même si Facebook a, en réalité, tout intérêt à garder secrète sa technologie. « Le fait de dire aux gens que les prédictions peuvent se produire peut en soi influencer les résultats », a dit M. Hwang.

Les arrivées d’air extérieures sont vues lors d’une visite du nouveau centre de données Facebook le 19 avril 2012 à Forest City, Caroline du Nord. Photo : Rainier Ehrhardt/Getty Images

Facebook a été harcelé de controverses sur les données et de scandales relatifs à la protection de la vie privée d’une forme ou d’une autre – à un degré presque comique – tout au long de ses 14 ans d’histoire. Malgré des excuses répétées d’année en année de la part de la compagnie, rien ne change vraiment. C’est peut-être la raison pour laquelle l’entreprise s’est jusqu’à présent concentrée sur ses utilisations bienveillantes et sympathiques de l’intelligence artificielle, ou IA.

FBLearner Flow a été présenté comme un ensemble de logiciels à usage interne qui aideraient Facebook à s’adapter à vos préférences chaque fois que vous vous connectez. « Beaucoup des expériences et des échanges que les gens ont aujourd’hui sur Facebook sont rendues possibles grâce à l’IA », a écrit Jeffrey Dunn, ingénieur de Facebook, dans un billet d’introduction au sujet de FBLearner Flow.

Interrogé par Stacey Higginbotham de Fortune sur les objectifs à cinq ans de Facebook en matière d’apprentissage automatique, Mike Schroepfer, directeur de la technologie, a déclaré en 2016 qu’il visait à faire que l’IA « crée chacun des moments que vous passez sur le contenu et les personnes avec qui vous voulez le passer ». L’utilisation de cette technologie pour la publicité n’a pas été mentionnée. Un article de TechCrunch 2017 déclarait : « L’intelligence artificielle est l’avenir de la monétisation pour Facebook », mais ne citait les dirigeants de Facebook que de la manière la plus édulcorée : « Nous voulons comprendre si vous êtes intéressé par quelque chose en général, ou bien tout le temps. Certaines choses que les gens font de façon périodique, hebdomadaire ou à un moment précis, et il est utile de savoir comment cela va et vient », a déclaré Mark Rabkin, vice-président de l’ingénierie publicitaire de Facebook. La compagnie a également été vague au sujet de la combinaison d’apprentissage automatique et de la publicité dans un article de 2017 de la revue Wired consacré aux travaux de l’entreprise en matière d’intelligence artificielle, qui faisait allusion aux essais « pour afficher des annonces plus pertinentes » en utilisant l’apprentissage automatique et pour anticiper les annonces auxquelles les consommateurs seraient les plus susceptibles de cliquer, une utilisation bien ancrée de l’intelligence artificielle. Plus récemment, lors de son audition devant le Congrès, M. Zuckerberg a présenté l’intelligence artificielle comme un outil de lutte contre le discours de haine et le terrorisme.

Mais d’après le document, le service enrichi d’intelligence artificielle que Facebook semble offrir va bien au-delà de « comprendre si vous êtes intéressé par quelque chose en général, ou bien tout le temps ». Pour Frank Pasquale, professeur de droit à l’Université du Maryland et chercheur au Yale’s Information Society Project qui se consacre à l’éthique algorithmique, ce type de marketing basé sur de la modélisation comportementale ressemble à une machine à apprendre le « racket de protection ». Comme il l’a dit à The Intercept :

Vous pouvez considérer que Facebook assure une surveillance protectrice [sur] la façon dont les concurrents vont essayer d’attirer des clients… Nous pouvons superviser pour vous et voir quand votre rival essaie de vous piquer quelqu’un, [puis] nous allons intervenir et nous assurer qu’ils reste dans votre camp.

L’intelligence artificielle est plus ou moins devenue un mot branché comme n’importe quel autre, mais au sens large, elle inclut des technologies comme « l’apprentissage automatique », grâce auquel les ordinateurs apprennent, essentiellement par eux-mêmes, à être de plus en plus efficaces dans des tâches aussi diverses que la reconnaissance faciale et la détection de la fraude financière. Vraisemblablement, FBLearner Flow apprend à être chaque jour plus précis.

Facebook est loin d’être la seule compagnie qui s’efforce de transformer les innovations de la recherche sur l’IA en une source de revenus, mais ils sont dans une situation unique. Même Google, avec son emprise sur les recherches sur le web et les e-mails et, également, des budgets illimités, ne dispose pas ce qu’a Zuckerberg : Une liste de 2 milliards de personnes avec ce qu’elles aiment, ce qu’elles pensent et qui elles connaissent. Facebook peut embaucher les meilleurs et les plus brillants des docteurs et dépenser une somme d’argent inépuisable dans la capacité de traitement.

La division IA de Facebook s’est tournée vers différentes techniques d’apprentissage automatique, parmi lesquelles les « Gradient boosted decision trees », ou GBDT [arbres de décision boostés par gradient,NdT] qui, selon le document, sont utilisés à des fins publicitaires. Un article de 2017 de la revue Proceedings of Machine Learning Research décrit le GBDT comme « une technique d’apprentissage automatique puissante, qui possède un large éventail d’applications commerciales et académiques et produit des résultats de pointe pour de nombreux problèmes complexes d’exploration de données ». Cette technique d’apprentissage automatique est de plus en plus populaire dans l’industrie de l’exploration de données.

Le vif intérêt de Facebook à aider des clients à produire de la valeur à partir des données des utilisateurs contribue peut-être à expliquer pourquoi la compagnie n’a pas condamné ce que Cambridge Analytica a fait avec les données extraites du réseau social – au lieu de cela, l’indignation de Facebook s’est concentrée sur la tromperie de Cambridge Analytica. Grâce à l’équipe de communication de Facebook, le débat a porté sur « l’accès inapproprié » de Cambridge Analytica aux données de Facebook, plutôt que sur les raisons pour lesquelles Cambridge Analytica voulait les données de Facebook au départ. Mais une fois que vous enlevez la question de l’accès et de l’origine, Cambridge Analytica commence à ressembler à la petite sœur de Facebook, en moins ambitieuse.

La capacité à atteindre la population cible a déjà causé des problèmes à Facebook, à de nombreuses reprises, en partie parce que les systèmes publicitaires de la compagnie sont conçus avec un incroyable niveau d’automatisation. Des journalistes de ProPublica ont récemment réussi à envoyer des publicités ciblées à des groupes douteux comme ceux qui se proclament « Jew haters » [ceux qui haïssent les Juifs, NdT]. Qu’il s’agisse d’une campagne politique visant à effrayer un certain type d’électeurs indécis, ou de Russes qui tentent simplement de semer la pagaille, la technique publicitaire de Facebook a été utilisée à plusieurs reprises à des fins troublantes, et il reste à savoir si une entité devrait avoir la possibilité de vendre l’accès à plus de 2 milliards d’usagers dans le monde entier. Pendant ce temps, Facebook semble accélérer, plutôt que de modérer, le caractère opaque de son modèle économique. Venant de la part d’une compagnie qui a été vivement critiquée pour son usage d’algorithmes anonymes pour mener ses affaires, le choix de l’intelligence artificielle auto-apprenante pour explorer des données n’a rien de rassurant.

Le fait que Facebook propose de vendre sa capacité à prédire vos actions – et votre fidélité – revêt une importance particulière au lendemain de l’élection de 2016, dans laquelle l’équipe numérique de Trump a utilisé le ciblage Facebook pour remporter un succès historique. Facebook travaille régulièrement avec des équipes de campagnes dans le monde entier et se vante de sa capacité d’influencer le taux de participation – une « success story » de Facebook, sur son travail avec le Scottish National Party, décrit la collaboration comme ayant « déclenché un raz-de-marée ». Depuis que Zuckerberg a honteusement nié la capacité de Facebook à influencer les élections, capacité dont Facebook avait auparavant fait la promotion, la compagnie peine se justifier. Tant que Facebook ne reconnaît pas sa capacité d’influence basée sur sa connaissance des gens, est-il normal que l’entreprise poursuive son développement en matière d’influence à partir des prédictions sur les individus?

Jonathan Albright, directeur de recherche au Tow Center for Digital Journalism de l’Université Columbia, a déclaré à The Intercept que, comme tout algorithme, en particulier ceux de Facebook, le ciblage par l’IA « peut toujours être utilisé comme une arme ». Albright, qui est devenu un détracteur de la capacité de Facebook à canaliser l’influence politique, s’inquiète de la manière dont ces techniques pourraient être utilisées dans le cadre d’élections, en prédisant quelles « personnes… pourraient être poussées à ne pas voter », par exemple.

« Une fois qu’ils ont fait cette prédiction, ils ont un intérêt financier à ce qu’elle se réalise. »

Une section du document met en lumière une réussite de Facebook qui a aidé un client à monétiser un groupe ethnique spécifique, bien que la méthode employée – FBLearner Flow ou plus conventionnelle – ne soit pas claire. Facebook a supprimé la possibilité de cibler les groupes ethniques en fin d’année dernière après la publication d’un rapport de ProPublica.

Pasquale, le professeur de droit, a déclaré à The Intercept que le travail de prédiction comportementale de Facebook avait de quoi donner des frissons. Il s’inquiète de la façon dont l’entreprise pourrait transformer les prédictions algorithmiques en « prophéties auto-réalisatrices », car « une fois qu’ils ont fait cette prédiction, ils ont un intérêt financier à ce qu’elle se réalise ». Quand Facebook prédit à un annonceur ce que vous allez faire le mois suivant, il incombe à l’entreprise, soit de faire en sorte que l’événement se produise, soit de montrer qu’elle a réussi à l’empêcher efficacement (ceci dit, comment Facebook pourrait-il assurer à son client que c’est son action qui a changé l’avenir ?).

Les incitations créées par l’IA sont déjà problématiques lorsque la technologie est utilisée pour pousser à l’achat, mais plus encore si elle est utilisée pour un scrutin. Rumman Chowdhury, qui dirige Responsible AI initiative d’Accenture, a souligné le fait que, comme les suggestions de Netflix ou d’Amazon, les prédictions algorithmiques plus ambitieuses pourraient non seulement deviner le comportement d’un utilisateur de Facebook, mais aussi le renforcer : « Les moteurs de recommandation sont incités à vous donner des liens sur lesquels vous cliquerez, pas nécessairement des informations utiles ».

Facebook n’a ni répondu aux questions répétées sur les types de données d’utilisateurs utilisés pour les prédictions comportementales, ni indiqué si cette technologie pourrait être utilisée dans des contextes plus sensibles comme les campagnes politiques ou les soins de santé. Au lieu de cela, l’équipe de relations publiques de Facebook a déclaré que l’entreprise utilise « FBLearner Flow pour gérer différents types de processus » et que « l’apprentissage automatique est un type de processus qu’il peut gérer ». Facebook a nié que FBLearner Flow soit utilisé pour des applications de marketing (une « mauvaise interprétation ») et a déclaré avoir « indiqué publiquement, en toute transparence, l’utilisation de l’apprentissage automatique dans le domaine de la publicité », faisant référence à l’article de 2017 de Wired.

Autre problème : la réticence de Facebook expliquer comment il monétise l’IA. Albright voit dans cette réticence un symptôme du « conflit inhérent » entre Facebook et la « responsabilité », car « ils ne peuvent tout simplement pas divulguer au public la plupart des détails sur ces sujets car il s’agit du cœur de leur modèle économique ».

Facebook a dit qu’il utilise « FBLearner Flow pour gérer différents types de processus ».

Mais Facebook n’a jamais souhaité divulguer quoi que ce soit hormis les exigences de la Securities and Exchange Commission et sa communication de crise. L’entreprise a prouvé à maintes reprises qu’elle pouvait falsifier les faits, puis, rattrapée par la réalité, s’en sortir avec des déclarations boiteuses à la presse et des messages insipides de Zuckerberg.

Et pourtant, le nombre de personnes dans le monde qui utilisent Facebook (et la trésorerie de l’entreprise) continue d’augmenter. Facebook a joui d’une sorte d’immunité d’image, du moins jusqu’au scandale de Cambridge Analytica. Une chaîne de fast-food qui serait, par exemple, accusée de négligence envers ses clients, ne s’en sortirait sans doute pas indemne. Il est possible que les gens ne se soucient pas assez de leur vie privée pour que leur colère conduise Facebook à changer de façon significative.

Peut-être que suffisamment d’utilisateurs de Facebook se résignent à l’idée d’avoir signé un pacte avec le démon du Big Data, et s’attendent à ce que leur vie personnelle serve à alimenter les algorithmes d’apprentissage automatique publicitaire. Hwang a noté que « nous ne pouvons pas oublier l’histoire de tout cela. La publicité, en tant qu’industrie, depuis des décennies, tourné autour de la prédiction du comportement… des individus et des groupes… C’est en quelque sorte le but de la publicité ». Mais nous ne pouvons pas non plus nous attendre à ce que les utilisateurs de Facebook, ou de toute autre technologie, soient en capacité de décider de ce qui vaut la peine d’être dénoncé et ce qui vaut la peine d’être craint , alors qu’ils sont délibérément maintenus dans un état d’ignorance quasi-totale. Chipotle [une chaîne de restauration rapide, NdT] est obligé réglementairement de vous informer précisément sur ce qui vous est servi, et sur les quantités. Facebook n’a pas l’obligation d’expliquer ce qu’il fait exactement de vos données au-delà des révisions successives de sa politique de confidentialité, qui se contente de lister ce que Facebook se réserve le droit de faire. Nous savons que Facebook s’est engagé dans le même genre d’interférence politique, amorale, que Cambridge Analytica parce qu’ils avaient l’habitude de s’en vanter sur leur site Web. Maintenant, les vantardises ont disparu, sans explication, et nous sommes de nouveau dans l’obscurité.

Ainsi, bien que les détails de ce qui est fait de vos données demeurent en grande partie une question de secret commercial pour Facebook, nous pouvons considérer ce qui suit : Mark Zuckerberg affirme que son entreprise a « la responsabilité de protéger vos données, et si nous ne le pouvons pas, nous ne méritons pas d’être à votre service ». D’un autre côté, Zuckerberg dirige une entreprise qui utilise vos données pour alimenter des modèles de prédiction par l’IA, qui seront utilisés pour vous cibler et vous soutirer de l’argent sur la base de ce que vous allez faire à l’avenir. Il semble difficile de concilier ces deux faits – peut-être parce que c’est impossible.

Source : The Intercept, Sam Biddle, 13-04-2018

Traduit par les lecteurs du site www.les-crises.fr. Traduction librement reproductible en intégralité, en citant la source.

Nous vous proposons cet article afin d'élargir votre champ de réflexion. Cela ne signifie pas forcément que nous approuvions la vision développée ici. Dans tous les cas, notre responsabilité s'arrête aux propos que nous reportons ici. [Lire plus]Nous ne sommes nullement engagés par les propos que l'auteur aurait pu tenir par ailleurs - et encore moins par ceux qu'il pourrait tenir dans le futur. Merci cependant de nous signaler par le formulaire de contact toute information concernant l'auteur qui pourrait nuire à sa réputation.

Commentaire recommandé

« Facebook a essayé de prendre une position morale sur votre vie privée »

J’ai tiqué sur cette première phrase. Les dirigeants d’une entreprise n’ont aucune obligation juridique de prendre une position morale. Par contre, ils ont l’obligation juridique (sous peine de licenciement ou amende/prison) de maximiser les profits des actionnaires. La position « morale » de Facebook est donc une position économico-financière : il est préférable pour eux (financièrement) de prétendre à la moralité en changeant les pratiques contestables, afin de garder des utilisateurs donc des annonceurs.

Un dirigeant d’entreprise est tenu d’évoluer dans un cadre légal, pas un cadre moral. C’est au législateur de faire évoluer le cadre légal pour contenir les actions « immorales » des entreprises.

26 réactions et commentaires

« 29 000 critères caractérisant chacun des utilisateurs de Facebook. » : c’est exactement ce que je disais dans http://onfoncedanslemur.blog/2018/03/15/intelligence-artificielle-et-betise-naturelle : les IA « pourront faire des analyses exhaustives et pointues pour fournir une pléthore d’informations sur un contenu linguistique quelconque, et aucun analyste humain ne pourra faire mieux. Autrement dit, elles pourront juger n’importe quel texte bien mieux que nous. » Mais un internaute m’avait répondu que ce n’était « qu’une annonce commerciale ». Dans http://onfoncedanslemur.blog/2018/03/18/quelque-chose-deffrayant-dans-lia, j’ai répondu que : » il se trompe, il n’a pas admis l’idée fondamentale qu’il n’est pas nécessaire de comprendre pour produire une réponse pertinente, c’est-à-dire « intelligente ». » Le présent article montre que j’étais encore en-dessous de la vérité : une IA peut « comprendre » puisqu’elle peut « prédire »…

+4

Alerterimaginons une personne qui ne poste et ne regarde que des videos de maquillage ou que des videos de foot et qu’elle annonce en ligne qu’elle va se marier et ou avoir des enfants. L’ia va donc predire qu’elle va moins acheter de maquillage ou de place de foot et plus de couche culotte? Bon l’automatisation de ce genre d’analyse va permettre de cibler tous les consommateurs « non cartesiens » plus facilement. La belle affaire…

Facebook vend les informations de ses utilisateurs. Bah,l’efficacite des techniques de manipulations d’opinion et de marketting est connue depuis longtemps: pour ca que les publicitaires sont autant payes,ils amenent des profits et des ventes supplementaires.

Aux consommateurs et aux electeurs de s’adapter s’ils ne veulent pas etre tondus…Obama a utilise en premier ces techniques,maintenant c’est trump…Macron utilise le big data, que ses opposants fassent pareil…

+2

Alerter@Calal : Ce n’est pas Obama qui a introduit les techniques de marketing commercial en politique, c’est Bill Clinton lors de sa seconde campagne en 1996. Les sondages le donnaient nettement perdant, alors il a eu « une idée de génie » : virer son staff politique et prendre de purs propagandistes commerciaux à la place. Plus de programme, plus d’idées politiques, juste des focus groups quotidiens pour savoir quels éléments de langage utiliser dans sa prochaine apparition médiatique. Et le langage contraire le lendemain s’il le faut. Ça a marché, il a été brillamment réélu. Et ça s’est su. Tony Blair a aussitôt repris la méthode en Grande-Bretagne, avec succès. Depuis tous les politiciens anglo-saxons ont adopté le truc. Je suppose que les politiciens français essayent d’en faire autant, sans doute en moins massif et moins efficace — nous ne sommes que la province des États-Unis, après tout.

+0

Alerter« »une IA peut “comprendre” puisqu’elle peut “prédire”… » »

Heu… rien que des 0 et des 1, des probas et de la manipulation.

Ça marche, statistiquement, mais de là à dire qu’il y a compréhension.

Imaginons qu’a titre individuel ou collectif un groupe social décide de « saboter » les algos en cliquant de manière réfléchie sur du n’importe quoi pour tromper. Le truc est incapable de comprendre que vous le dévoyez. Je l’ai fait. Vous pouvez l’envoyer dans n’importe quelle direction.

Un humain comprendrai… qu’on se fout de sa gueule.

Ps: Si vous faites ça, faites soigneusement gaffe à ne pas l’envoyer là où il pourrait vous faire foutre en taule… 🙂

+5

AlerterOui, l’IA ne peut rien « comprendre » mais il peut « prédire », et c’est plus « fort » que « comprendre ». Note : pourriez-vous me dire où l’on peut s’amuser à saboter un algo ? Ca m’intéresse grandement.

+4

AlerterPour saboter les algos , il faut introduire du bruit dedans : créer de faux comptes et les alimenter de fausses infos . Ainsi vous polluerez un tout petit peu l’algo. et lui ferez perdre un tout petit peu de sa précision .

+1

Alerterc’est le principe de l’extension track me not pour les navigateurs web. Pour induire des erreurs de prédiction dans les algos, soit vous êtes partiellement silencieux (ça peut se détecter), soit vous générer des données impertinentes au milieu des données légitimes (ça peut aussi se détecter)

+0

Alertertu es trop sure de toi : l’IA sera largement capable, je pèse mes mots, d’être largement plus évolué que le cerveau du type lambda , et avec certains il n’y aura pas trop de difficulté !

Déjà avec le 0 et les 1 tu peux déjà mettre cela de côté : on passe à l’ordinateur quantique donc ce n’est plus 0 ou 1 … mais un codage beaucoup plus riche (oui peut etre etc …) avec la notion de superposition d’état, si Schrödinger te cause … : le qBit.

Source : https://fr.wikipedia.org/wiki/Qubit (je n’aime pas Wikipedia c’est un nid de manipulation).

Si on se met à parler de réseaux neuronaux … on commence à avoir très mal.

Source : https://www.youtube.com/watch?v=kHuIhhLPD2w

Croyez nous quand on vous dit que c’est l’atome de demain … avec ces avantages et immenses travers.

+1

AlerterUne remarque : que FB influence mes choix de consommateur, je m’en tape un peu, parce qu’ils sont de toute façon déterminés d’abord par mon budget. Et si j’avais un gros budget pour me payer de grosses bagnoles, où serait le problème éthique de faire un choix « sous influence » ? Tout choix de ce genre est, de toute façon, déjà influencé, il n’y a pas de « choix ex nihilo ».

+1

AlerterC’est intéressant, parce qu’au moins, là, il effleurent les questions et problèmes importants.

mais cet article ne fait qu’effleurer les points clés.

ces articles décrivent déjà depuis l’été dernier les tenants et aboutissants de ces sujets.

d’une part l’IA (en général, pas que chez les GAFA).

et les GAFA et la mécanique qu’ils mettent en place.

cri : pensée du jour 171103 : l’intelligence artificielle sera à la vie quotidienne, ce que le centre d’appels est à la relation avec les fournisseurs.

https://www.les-cris.com/pages-010-quelques-articles-2018/cri-pensee-du-jour-171103-l_intelligence-artificielle-sera-a-la-vie-quotidienne.php

il y a aussi, dans cet article, cette pensée du jour, que j’aime beaucoup :

L’Intelligence Artificielle est un artifice pour tirer les ficelles…. au nom de l’intelligence.

cri : colonisation-par-les-services-digitalises – les services mondialisés, les « plateformes », les GAFAM,… mettent en place une nouvelle forme de colonisation .

https://www.les-cris.com/pages-010-quelques-articles-2018/cri-pensee-du-jour-171103-l_intelligence-artificielle-sera-a-la-vie-quotidienne.php#colonisation-par-les-services-numeriques

cri : les gens adorent ça ! (la colonisation-par-les-services-numériques).

https://www.les-cris.com/pages-010-quelques-articles-2018/cri-la-revolution-de-la-circulation-juste-la-sous-vos-yeux-20180306-23695.php#colonisation-par-les-services-numeriques__Les-gens-adorent-ca

et un point important : il n’y a pas que les particuliers, qui se font spolier,… il y a aussi les commerçants, les TPE, les PME….

cri : commerçants, PME : le risque sur Facebook, Google est énorme !.

https://www.les-cris.com/pages-010-quelques-articles-2018/cri-commercants-PME-le-risque-sur-Facebook-Google-est-enorme-20180316-24150.php

ces articles sont des constats, des reflexions,… à prendre avec discernement, et pour animer une réflexion….

+5

AlerterPlus que le marketing ciblant les particuliers, le risque de dépendance économique ou de vampirisme pour les TPE et PME, compte-tenu de tous les passifs déjà connus me semble effectivement une mise en garde bien plus sérieuse concernant les GAFAM, particulièrement en matière de vente à distance où les TPE et PME se retrouvent à verser une commission à un intermédiaire qui peut devenir (voire est aussi déjà) leur concurrent.

Maintenant, quand l’intérêt des GAFAM est de toucher le plus possible de commissions, plutôt que de tuer la concurrence, ils ont tout intérêt à exacerber la concurrence entre les petites structures et le choix et tuer les gros concurrents (et ils se battent d’ailleurs déjà entre eux). Reste qu’il y a les concurrents chinois, genre Tencent ou AliBaba, qui vont devenir de plus en plus dangereux, même pour les GAFA.

+2

Alerter« Facebook a essayé de prendre une position morale sur votre vie privée »

J’ai tiqué sur cette première phrase. Les dirigeants d’une entreprise n’ont aucune obligation juridique de prendre une position morale. Par contre, ils ont l’obligation juridique (sous peine de licenciement ou amende/prison) de maximiser les profits des actionnaires. La position « morale » de Facebook est donc une position économico-financière : il est préférable pour eux (financièrement) de prétendre à la moralité en changeant les pratiques contestables, afin de garder des utilisateurs donc des annonceurs.

Un dirigeant d’entreprise est tenu d’évoluer dans un cadre légal, pas un cadre moral. C’est au législateur de faire évoluer le cadre légal pour contenir les actions « immorales » des entreprises.

+12

AlerterVaste débat que celui du choix et du libre arbitre. L’humain étant un animal social, il est par nature sous influence. Ses comportements sont soumis à l’approbation du groupe. Il choisira en général ce qui lui donne plus d’estime de soi, de reconnaissance sociale et de pouvoir ou de sécurité matérielle, selon le sexe. Je schématise bien sur.

Avant la société dite de consommation, il y avait un ordre social qui se transmettait par le mariage et le travail. L’église et l’école avaient le monopole de l’influence. Les marchands étaient là pour satisfaire les besoins plus que les désirs pour le plus grand nombre.

La publicité traverse l’atlantique après la guerre de 40 avec les marchands, comme les rats avec les navires. L’influence passe dès lors par le désir mimétique au moyen d’objets et l’ordre moral cède la place à l’ordre matériel (la fameuse chanson de B. Vian, la complainte du progrès). La publicité joue désormais le rôle de filtre social. Les images mettent en scène des objets de désir sexuellement et socialement attractifs. Votre libre arbitre consiste alors à organiser le dialogue entre vos désirs et votre banquier….

La télévision devient l’organe central de la publicité. Elle met en scène et sélectionne tout ce que vous devez savoir, aimer et faire et influence vos intentions de vote.

Jusque là rien d’interactif et pourtant ça marche, les gens se laissent appâter comme des carpes en eau trouble.

Arrive alors internet et l’interactivité et là, les désirs parlent aux désirs, sans intermédiaire apparent. Les gens sont acteurs et metteur en scène donc se croient libres tout en devenant des proies faciles pour les marchands car les techniques d’influence évoluent. Et voilà l’IA qui arrive pour remplacer la publicité. Représente-telle un nouveau saut qualitatif ? Quel nouveau filtre social est en train de se mettre en place et quelles en seront les conséquences? A quel nouveau piège l’humain est-il en train de se laisser prendre?

+3

AlerterC’est marrant cet histoire de libre arbitre. Comme si dire que l’esprit humain est une « simple » propriété émergente d’un pur processus physico-chimico-biologique implique d’une quelconque façon le caractère déterministe (au sens des dictionnaires) de ce processus et donc de l’esprit humain. Associer « libre arbitre » et « sous influence » ne me paraît pas contradictoire dans le sens où le comportement humain me semble toujours une combinaison des deux.

D’autre part, je ne comprends pas vraiment ce renvoi à « l’animal social » que l’on trouve souvent, je ne voie pas très bien ce que cela signifie. Je comprends que l’esprit humain ne puisse manipuler des concepts mêmes associés à « 2 + 3 = 5 » sans identité(s) culturelle(s) (culturel au sens de corpus de connaissances, croyances et conventions sociales), mais l’association « animal » et « social » me laisse perplexe.

+0

Alerter@LS, « animal social » n’est pas une spécificité humaine mais une caractéristique que nous partageons avec d’autres animaux. Disons que dans le cas de l’humain, l’aspect social s’est complexifié.

Je suis d’accord que le libre arbitre et être sous influence ne s’opposent pas, je n’ai pas dit le contraire. J’ai simplement essayer de lier les deux. Acheter une voiture rouge relève du libre arbitre mais acheter tel modèle plutôt qu’un autre, plus vraiment. Est-ce dire que beaucoup de nos comportements sont pré-déterminés? Non mais influencés oui. Je vous laisse apprécier la nuance.

+2

AlerterL’idée d’acheter une marque à cause du marketing est un concept douteux en général et particulièrement pour une voiture. Les observations et les rencontres que j’ai pu faire tendent à montrer que le marketing est loin d’être si efficace. Il marche -relativement- sur les produits de consommation courante, un peu moins sur les produits chers et beaucoup moins dès lors que dans la majorité de la population, c’est un produit très coûteux; là, la tradition familiale, le budget et les goûts sont loin d’être négligeables.

Je n’irai jamais acheter une voiture que je trouve affreuse, quel que soit son prix ou sa marque. Le libre arbitre est forcément sous influence (on évolue dans un monde rempli de contradictions et où la liberté totale est un absolu impossible à atteindre) mais la toute puissance du marketing est un mythe… Pour m’y intéresser depuis les début du web, les résultats sont surfaits, il y a tout un tas de biais dans les questionnaires qui gonflent les résultats « favorables » : impossibilité de dire « ça ne me concerne pas », « je m’en fiche », « je n’ai pas les moyens ». On choisit alors par défaut (si on ne quitte tout simplement pas le questionnaire), mais le résultat n’a pas de valeur concrète. J’ai cessé il y a déjà quelques années tous ces questionnaires tellement les biais sont grossiers : vous devez aimer plus ou moins mais détester, ça n’existe pas, et l’indifférence, c’est encore pire, c’est l’aspect le moins envisagé de tous.

L’impact du marketing sur les ventes est réel, mais… il repose un biais favorable, une réceptivité déjà présente, il la crée rarement, il peut même provoquer une réaction de rejet (ce que même les marketeurs reconnaissent).

Si on n’a pas l’argent, pas de projet d’achat, le marketing… bof.

+3

Alerteret la intervient le credit a la consommation, la location avec option d’achat etc…

Je me marre en regardant les pubs pour les voitures a la tele: difficile de voir le prix de la voiture,tout ce qui est mis en avant c’est le cout journalier d’une location…Toutes ces grosses voitures qui roulent (encore?) sur les routes francaises,combien sont achetees a credit ou louees?

+0

AlerterCe qui est marrant c’est que les faits sont sans appel , les buts et les méthodes de ces GAFA sont maintenant bien connus . Et pourtant combien de personnes ont renoncé à facebook après les récents scandales ? 5 ? 6 ?

Ces trucs sont les nouvelles drogues dures dont le peuple n’a même pas l’idée de se sevrer .

+5

AlerterDe tous temps un grand nombre de gens a prefere,prefere et preferera des mensonges reconfortants a une verite derangeante…La,les reseaux sociaux et l’ia permet de rassembler et de coacher ce « troupeau » d’une facon « scientifique »,quantifiable.

Le probleme qui risque de se poser c’est que les « moutons noirs » seront egalement rapidement identifiables: a quels traitement seront ils soumis? un ministere de la verite qui organise une fausse rebellion pour detourner la colere dans des voies de garages sans danger ni efficacite? des agents infiltres facon fbi qui fournissent tous les elements pour faire un attentat et pousser a la faute un « resistant trop naif »?

D’ailleurs j’ai vu un article recemment sur zerohedge ou il est question de recherche faites par la cia sur comment duper tous ces ai et cameras car les espions et autres agents doubles auraient du mal a operer sous couverture en chine a cause de toussa…

+3

AlerterOn peut au moins essayer de se passer, à défaut du service, de son prestataire.

https://degooglisons-internet.org/liste

Facebook → Diaspora (réseau social décentralisé au sein duquel Framasoft propose sa propre instance, Framasphère)

Twitter → Mastodon (équivalent décentralisé, avec par exemple Framapiaf)

Skype → Framatalk (pas de compte nécessaire)

Etc.

+2

AlerterEt si quelqu’un a une idée pour remplacer android (pas par apple), je suis preneur !!

Il y avait un os deTizen, mais qui ne semble plus être disponible, et il y a en 5 ou 6 os libres en développement pour smartphone, mais pour quand une version fonctionnelle ?

Je vais réactiver mon ancien Nokia N900….

+3

AlerterIl y a (à mon avis) mieux:

Baisefou: jamais eu

touitère: jamais eu

cekahipe: jamais eu

etc

A part ça:

téléphone portable: j’ai ignoré mes principes pour raison de paix familiale. Mais

quand je sors, la table de la cuisine porte le portable.

Je paye en liquide, sauf si plus de 1000 € (charpentier pour les bandeaux), c’est la loi!!!

Voiture: d’occase (< 1500 €), Sans gps, sans électronique sauf ABS. Ça va devenir difficile…

Quand un commerçant me demande mon nom (pour facture), c'est Jean Dupont, fausse

adresse et faux numéro.

Je n'arrive pas à me débarasser de l'ordi, mais j'essaye de me protèger un peu.

Messagerie: protonmail, pour l'important.

Malgré tout ça, je fonctionne très (assez…) bien.

Quelqu'un va finir par me dénoncer au service des tutelles.

+0

Alerterje fais à peu près pareil.

mais je paie ma facture d’electricité par prélèvement bancaire automatique….

pour moi, le but n’est pas d’éviter les outils et les services numériques.

au contraire, c’est de les utiliser à fond.

mais dans le sens qui m’est favorable et favorable pour les populations, le monde, les communautés des logiciels libres, des services CHATONS (http://chatons.org).

cela serait dommage de s’en priver.

surtout que les outils libres, … sont mis à disposition des personnes, …. sans exiger de contrepartie…

ils sont là pour nous…

pour cela, il est incontournable de faire beaucoup d’apprentissage, beaucoup de recherche d’information, pour bien connaître les outils que j’utilise, et que les autres, autour de moi, utilisent….

+0

AlerterMerci à toute l’équipe pour cette passionnante traduction qui compile un tas d’informations disséminées dans le net 🙂

+0

AlerterJ’ai quitté Facebook voici peu, brutalement, mais je n’ai jamais compris pourquoi les gens ne « niquaient » pas carrément la bête de l’intérieur. Je vous assure qu’il n’y avait sur mon mur aucune publicité, ni sponsoring ni rien, venant soit des algorithmes de FB, soit des copains. Rien, nada, Nichts, nothing ! C’est bien simple, je ne supporte pas la publicité. Et quand je dis que je ne la supporte pas, ce n’est pas que je bougonne quand j’en vois, c’est que je la supprime, avec des outils adéquats. J’utilise AdBlockPlus, uBlock et une petite merveille (AdZhosts) trouvée chez H16, qui envoie toutes les requêtes publicitaires dans mon fichier Windows Hosts avant qu’elles ne s’affichent sur mon écran. Quand je vois Internet chez les autres, je suis horrifié. Comment peut-on supporter tous ces bidules trucs machins qui gigotent, vous incitent à acheter Blob en urgence, et à acquérir Choin à toute vitesse ?! Bref, si tout le monde comme moi niquait la pub sur FB, eh bien FB n’existerait plus, ni l’horrible Zuckerberg à qui j’intenterais bien un procès en sale gueule (et cela n’a rien à voir avec ses origines).

+3

AlerterConfidentiel ? Futur ? C’est du foutage de gueule à l’image de la « révolutionnaires » innovation de Apple qui existait depuis 2 ans chez Samsung…

+1

AlerterLes commentaires sont fermés.